الکس لوروسو[۱]، فعال رسانهای راستگرا در مراسم معرفی شرکت جدید ایلان ماسک یعنی xAI، پرسشی جانبدارانه مطرح کرد. لوروسو پرسید که اخیرا چتجیپیتی در حال «ویرایش حقیقت» است، برای مثال «پاسخهای عجیبی مانند اینکه بیش از دو جنسیت وجود دارد» ارائه میدهد. او از ماسک پرسید آیا این موضوع تاثیری بر تصمیم ماسک مبنی بر راهاندازی شرکت هوش مصنوعی خودش داشته یا خیر؟

ماسک پاسخ داد: «من باور دارم که آموزش دادن هوش مصنوعی با مقاصد و اهداف سیاسی خطر بزرگی است، یا به عبارتی اینکه هوش مصنوعی را طوری آموزش بدهیم که از بیان کردن آنچه فکر میکند واقعی است خودداری کند.» او پیشتر در همان مراسم گفته بود که هوش مصنوعی شرکت وی در «نهایت صداقت» خواهد بود. ماسک برای چندمین بار بود که AI خودش را بدین شکل تبلیغ میکرد.

« آموزش دادن هوش مصنوعی برای ووک بودن، به عبارتی دروغ گفتن، خطری فاجعهبار است.» این توییتی بود که ماسک دسامبر گذشته (۲۰۲۲) در پاسخ به سم آلتمن، بنیانگذار OpenAI، منتشر کرد.

بر کسی پوشیده نیست که ایلان ماسک رابطهای پیچیده با هوش مصنوعی دارد. او حدود یک دهه است که به طور علنی نسبت به تهدید وجودی نهفته در این فناوری نوظهور هشدار میدهد. اخیراً نیز نامهای سرگشاده را امضا کرده که بیانگر نگرانی جمعی از سرمایهداران و دانشمندان نامدار از نابودی بشریت توسط هوش مصنوعی است. در عین حال او همزمان در جهت توسعه AI سرمایهگذاریهای بسیاری کرده است. به طوری که خود او از سرمایهگذاران اولیه و اعضای اصلی هیئتمدیره OpenAI بود. او در اظهار نظری جدید گفته است هدف شرکت جدید xAI «درک ماهیت واقعی جهان» است.

اما انتقاد او از «بیش از حد ووک بودن» مدلهای بزرگ هوش مصنوعی در راستای شعار بزرگتر جناح راست قرار گرفته است؛ شعاری که از زمان رونق ابزارهای عمومی هوش مصنوعی مولد شکل گرفته است. در حالی که میلیاردها دلار سرمایه صرف رقابت برای ساخت پیشرفتهترین هوش مصنوعی میشود، هوش مصنوعی مولد همزمان به یکی از تازهترین میدانهای جنگ فرهنگی بدل شده است؛ جنگی که تهدید بزرگی است بر مدیریت استفاده از این فناوری و قانونگذاری بر آن.

« کار هوش مصنوعی مولد تنها بازترکیب و بازتولید چیزهایی است که در منابع آموزشی آن وجود دارد. جادو نمیکند.» مرِدیت بروسار

ورود هوش مصنوعی به جنگ فرهنگی

جمهوریخواهان آمریکا هم در کنگره و هم در جریان مبارزات انتخاباتی خود علیه شرکتهای بزرگ فعال در حوزه AI اعتراض کردهاند. ران دیسانتیس[۲]، نامزد جمهوریخواه ریاستجمهوری و فرماندار فلوریدا، در یک گردهمایی انتخاباتی هشدار داد که شرکتهای بزرگ هوش مصنوعی با مقاصد سیاسی از دادههای آموزشی «ووکتر» استفاده میکنند.

فعالان محافظهکاری همچون کریستوفر روفو[۳]، که بهعنوان کسی شناخته میشود که صدای انتقاد راستگرایان درباره آموزش نظریه نژادی انتقادی[۴] در مدارس آمریکا را بلند کرد، به دنبالکنندگان خود در شبکههای اجتماعی هشدار دادهاند که «هوش مصنوعی ووک» تهدیدی جدی است. رسانههای بزرگ محافظهکار مانند فاکس نیوز و نشنال ریویو نیز به گسترش این نگرانیها دامن زدهاند؛ به طوری که نشنال ریویو در گزارشی اعلام کرد که چتجیپیتی تسلیم «ایدئولوژی ووک» شده است.

فعالان راستگرا همچنین فرمان اجرایی جو بایدن مبنی بر توسعه عدالت در آموزش هوش مصنوعی را، بهعنوان اقدامی اقتدارگرایانه برای ترویج «هوش مصنوعی ووک» محکوم کردند. یکی از پژوهشگران محافظهکار مؤسسه منهتن[۵]، این فرمان را بخشی از یک «سرطان ایدئولوژیک و اجتماعی» توصیف کرد.

واکنش منفی جناح راست به هوش مصنوعی مولد یادآور مخالفت آنها با سیاستهای تعدیل محتوا در پلتفرمهای رسانه اجتماعی است. مشابه همان سیاستها، تدابیر امنیتی بسیاری در مدلهای هوش مصنوعی مانند چتجیپیتی طراحی شدهاند تا مانع استفاده از این فناوری برای ترویج سخنان نفرتانگیز، اطلاعات غلط ویا تبلیغات سیاسی شوند. اما جناح راست معتقد است این سیاستهای تعدیل محتوا، توطئهای است از سوی شرکتهای بزرگ فناوری و فعالان لیبرال برای ساکت کردن محافظهکاران.

شکل ۱. چتجیپیتی در حال پاسخ به سوالی در مورد خلاقیت در کامپیوترها

در همین حال، کارشناسان میگویند منتقدان هوش مصنوعی، عاملیتی بیش از حد واقعی به مدلهای مولد دادهاند و به اشتباه فرض میکنند که این سرویسها همچون موجودات آگاه دیدگاههای مستقل خود را دارند.

«کار هوش مصنوعی مولد تنها بازترکیب و بازتولید چیزهایی است که در منابع آموزشی آن وجود دارد. جادو نمیکند.» این را مرِدیت بروسار[۶]، استاد دانشگاه نیویورک و نویسنده کتاب «بیش از یک ایراد[۷]: رویارویی با سوگیری نژادی، جنسیتی و توانایی در فناوری» میگوید.

به گفته کارشناسان، واقعیتی که در تمام انتقادات راستگرایان نادیده گرفته شده تمایل سیستمهای هوش مصنوعی به تشدید نابرابریهای موجود و آسیب زدن به گروههای محروم است. مدلهای متنبهتصویر مانند Stable Diffusion، تصاویری تولید میکنند که حاوی کلیشههای نژادی و جنسیتی هستند. تحقیقی از وبسایت مارکاپ[۸] نشان داد الگوریتمهایی که برای ارزیابی درخواستهای وام مسکن طراحی شده بودند، متقاضیان رنگینپوست را ۴۰ تا ۸۰ درصد بیشتر از همتایان سفیدپوستشان رد کردهاند. درحالیکه ایالتهای آمریکا بر گسترش نظارت مبتنی بر هوش مصنوعی تاکید دارند، تحقیقات نشان میدهند سوگیری نژادی موجود در فناوریهای تشخیص چهره منجر به دستگیریهای ناعادلانه بسیاری شده است.

پیامدهای این جنگ فرهنگی

“هیچ مدلی از GPT وجود نخواهد داشت که همه بر بیطرفی آن توافق داشته باشند“

با این تفاسیر انتقادهای جناح راست از رهبران حوزه هوش مصنوعی پیشاپیش پیامدهایی به همراه داشته است. پیامدهایی مانند موج جدیدی از فشار جمهوریخواهان علیه دانشگاهیان و سرویسهای رصد اطلاعات غلط، و همچنین شکایت ماسک از سازمان ضد نفرتپراکنی «مرکز مقابله با نفرت دیجیتال[۹]» که وی مدعی است فعالیتهایش باعث دهها میلیون دلار زیان به درآمدزایی توییتر شده است. بنظر میرسد کارزار «ضد هوش مصنوعی ووک» شرکتهای هوش مصنوعی را تحت فشار قرار داده تا از نظر سیاسی ظاهری بیطرف داشته باشند.

Figure 2سم آلتمن، مدیرعامل OpenAI در مراسمی در دانشگاه کئو، توکیو، ۱۲ ژوئن ۲۰۲۳

پس از نخستین موج انتقادات محافظهکاران، OpenAI در فوریه ۲۰۲۳ مطلبی در وبلاگ خود منتشر کرد که به نظر میرسید برای آرام کردن منتقدان تمامی جناحهای سیاسی نوشته شده است. وی وعده داد منابعی برای «کاهش سوگیریهای بارز و نامحسوس در پاسخهای چتجیپیتی» اختصاص دهد.

همچنین سم آلتمن در مصاحبه با لکس فریدمن[۱۰]، پادکستر محبوب راستگرایان، گفت: «فکر میکنم این انتقادات بیش از حد جانبدارانه بود و همیشه هم این انتقادات خواهد ماند. هیچ مدلی از GPT وجود نخواهد داشت که همه بر بیطرفی آن توافق داشته باشند.»

فعالان راستگرا همچنین تلاشهایی برای راهاندازی هوش مصنوعی «ضد ووک» خود انجام دادهاند. مدیرعامل گب[۱۱]، یک پلتفرم اجتماعی محبوب میان ملیگرایان سفیدپوست و دیگر اعضای جناح راست افراطی، اوایل امسال اعلام کرد که میخواهد هوش مصنوعی خودش را ایجاد میکند. اندرو توربا اعلام کرد: «مسیحیان باید وارد رقابت تسلیحاتی هوش مصنوعی شوند» و مدلهای AI موجود را به داشتن «جهانبینی شیطانی» متهم کرد. جالب است بدانید که چتباتی در پلتفرم دیسکورد به نام BasedGPT که با مدل زبانی بزرگ لیکشده از فیسبوک آموزش دیده بود، خروجیهایی اغلب نادرست و بیمعنا داشت و حتی در پاسخ دادن به پرسشهای ساده نیز ناتوان بود. بنابراین بنظر نمیرسد تلاشهای این منتقدین برای توسعه AI شخصی خودشان به جایی برسد.

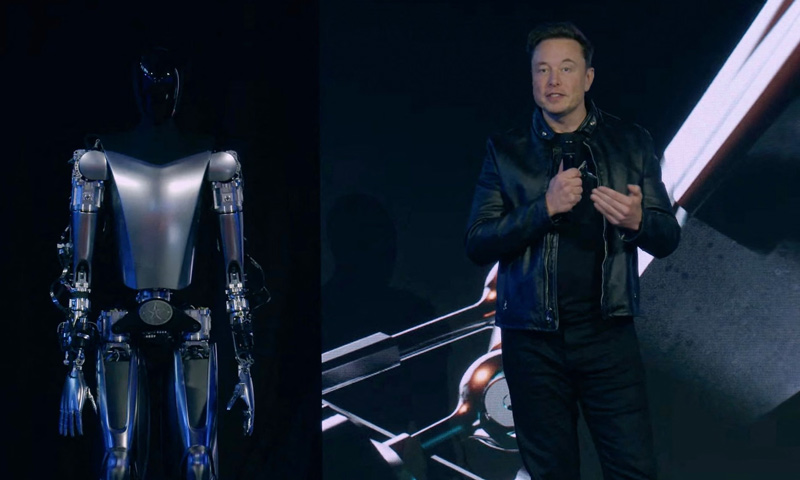

شکل ۳. ایلان ماسک در کنار ربات انساننمای اوپتیموس در کالیفرنیا، ۳۰ سپتامبر ۲۰۲۲

هنوز مشخص نیست آیندهٔ شرکت تازه تأسیس xAI چه خواهد بود. این شرکت در وبسایت خود اعلام کرده هدفش «درک ماهیت واقعی جهان» است و ]در اقدامی بحث برانگیز[ گروهی تماماً مردانه از پژوهشگران شرکتهایی مانند OpenAI و دانشگاه تورنتو را گرد هم آورده است. هنوز مشخص نیست هوش مصنوعی جدید این شرکت تا چه حدی «صادق» خواهد بود و از چه اصول اخلاقی پیروی خواهد کرد. این شرکت دن هندریکس[۱۲]، پژوهشگر مرکز ایمنی هوش مصنوعی را بهعنوان مشاور جذب کرده است. هندریکس پیشتر درباره خطراتی که هوش مصنوعی در بلندمدت برای بشریت خواهد داشت هشدار داده بود؛ نگرانیای که ماسک نیز بارها ابراز کرده است.

ماسک، xAI، هندریکس و مرکز ایمنی هوش مصنوعی برای اظهارنظر در دسترس ]نویسنده[ نبودند.

“هیچکس از مطالبی که در اینترنت وجود دارد راضی نیست، پس نمیدانم چرا باید از خروجیهای هوش مصنوعی مولد راضی باشند.“

چهرههایی مانند ماسک درباره آیندهٔ هوش مصنوعی معتقدند که در صورت آگاه شدن آنها، سوگیریها را خواهند آموخت و به صورت بالقوه به نیروهایی همهتوان ]وغیرقابل کنترل[ بدل میشوند. برخی پژوهشگران معتقدند پاسخ سادهتر به این پاسخ که چرا این مدلها آنگونه که مردم میخواهند رفتار نمیکنند، این است که آنها خام، خطاپذیر و منعکسکنندهی قطبیشدنهای سیاسی کنونی هستند. هوش مصنوعی مولد که با استفاده از دادههای انسانی آموزش دیده و از همان منابع برای تولید خروجی استفاده میکند، بیشتر شبیه آینهای است که بازتابدهندهی وضعیت پرتنش محتوای آنلاین است.

بروسار میگوید: «اینترنت بستری بسیار شگفتانگیز و همچنین بسیار سمی است». «هیچکس از مطالبی که در اینترنت وجود دارد راضی نیست، پس نمیدانم چرا باید از خروجیهای هوش مصنوعی مولد راضی باشند.»